Última actualizacón: 14 marzo 2018 a las 09:49

Quien más quien menos ha experimentado alguna vez un momento “eureka”, ese instante de lucidez que, a modo de fogonazo, nos revela la solución a un problema cuando ya nos habíamos dado por vencidos. Para algunos científicos, desconectar y dejar vagar los pensamientos libremente puede considerarse poco productivo y perjudicial, sin embargo, la realidad es que Arquímedes —si tomamos como verídica su historia— no fue el único que se aprovechó de estos momentos de relajación.

El primer protagonista de nuestra historia experimentó uno de estos destellos de lucidez un viernes por la noche en abril de 1983 1. Kary Mullis, biólogo molecular que trabajaba para Cetus Corporation, tenía una cabaña en el valle de Anderson (en el condado californiano de Mendocino) donde había decidido pasar el fin de semana con una amiga. Todo sucedió mientras se aferraba al volante de su coche que serpenteaba a la luz de la luna por una carretera de montaña que atraviesa un bosque de secuoyas (la famosa ruta 101). La noche estaba saturada de humedad y del aroma de la floración de los castaños.

En ese momento de relajación, propio de la conducción nocturna por carreteras desiertas, fue cuando le llegó la inspiración (aunque algunos afirman, con indudable mala intención, que el LSD también jugó su papel). Mullis llevaba tiempo buscando la forma de evitar el tedioso trabajo de laboratorio necesario para hacer múltiples copias de una secuencia particular de ADN por lo que, intuyendo que había dado con algo importante, paró el coche, cogió papel y lápiz y comenzó a hacer cálculos (la parada repentina molestó tanto a su acompañante que, refunfuñado, se pasó al asiento trasero del coche sin prestar atención al momento de revelación de su compañero). Por fin había dado con un proceso que permitía fabricar un número ilimitado de copias de cualquier gen: la reacción en cadena de la polimerasa (más conocido como PCR, por las siglas en inglés de polymerase chain reaction).

Al principio nadie creyó en su idea, aunque con perseverancia consiguió que el proceso funcionase, recibiendo por ello el Premio Nobel de Química en 1993. Desde ese momento, Mullis se volvió cada vez más excéntrico —por emplear un término suave— convirtiéndose, por ejemplo, en un firme defensor de la teoría de que el VIH no causa el SIDA, una postura que ha dañado tanto su credibilidad como los esfuerzos de la comunidad científica por hacer frente a la enfermedad.

Bien, pero, ¿qué es la PCR?

Esta técnica supuso una auténtica revolución en un campo que a mediados de los ochenta del siglo pasado comenzaba a despegar: la biología molecular. Si queremos saber qué es lo que hace un gen, o cuando necesitamos determinadas proteínas para el tratamiento de una enfermedad genética, o fabricar determinadas vacunas, se emplea una técnica llamada del ADN recombinante. Consiste en tomar una molécula de ADN de un organismo (ya sea un virus, una planta o una bacteria) para manipularla en el laboratorio e introducirla de nuevo en otro organismo para que produzca, por ejemplo, una proteína que le sea totalmente extraña. Es lo que venimos haciendo con la insulina que requieren los diabéticos 2. Pues bien, un requisito previo para aplicar esta técnica es contar con grandes cantidades de un segmento específico de ADN. Y eso es lo que hace precisamente la PCR.

Antes del perfeccionamiento de esta técnica solo podían obtenerse cantidades mínimas de un gen concreto, pero tras su invención, incluso un único gen puede amplificarse hasta obtener 100 billones de moléculas similares en una tarde. De esta forma se evita la clonación y permite emplear la PCR en fragmentos de ADN que estén presentes, inicialmente, en cantidades infinitesimalmente pequeñas.

Aunque parece algo sencillo a primera vista —podemos pensar que no es más que de una mera “fotocopia” de una molécula existente— lo cierto es que resulta bastante complicado de por sí obtener una molécula bien definida de ADN natural de cualquier organismo (con la excepción de algunos virus extremadamente sencillos). La doble cadena de ADN está rodeada y enrollada, dentro de la célula, por muchas proteínas. Cuando los biólogos tratan de aislar una cadena desnuda de ADN, ésta es tan larga y delgada que incluso las suaves fuerzas de corte empleadas la rompen en puntos aleatorios. De esta forma, si tomamos ADN de 1000 células idénticas, habrá 1000 copias de un gen concreto, pero cada copia estará en un fragmento de ADN de diferente longitud. Este proceso es en cualquier caso lento y costoso.

En realidad, lo que hace la PCR es simular lo que sucede en una célula cuando se sintetiza el ADN, aunque en nuestro caso mezclamos todos los ingredientes necesarios en un tubo Eppendorf: una ADN polimerasa, el tramo ADN del organismo que queremos estudiar, los oligonucleótidos (también llamados primers, iniciadores, cebadores, “oligos”, etc.) necesarios para que se inicie la transcripción, y los desoxirribonucleótidos trifosfato (dNTPs, con las cuatro bases nitrogenadas: adenina, timina, guanina y citosina); todo ello en las condiciones precisas para que la ADN polimerasa trabaje adecuadamente (cierto pH, determinadas cantidades de magnesio en forma de MgCl2, KCl, y algunas otras sales o reactivos, en función de cada polimerasa).

¿Cómo funciona?

El método consiste en realizar ciclos repetitivos que comienzan calentando el ADN para lograr que las dos hebras que lo conforman se separen y, al enfriarse, unos cebadores se acoplen en los extremos. La reacción de copia se lleva a cabo en presencia de ADN polimerasa y de los cuatro nucleótidos (A, T, G y C), donde cada hebra hace de plantilla para la síntesis de la nueva cadena. La función de la ADN polimerasa es añadir los nucleótidos libres a los de la cadena original. Una vez concluida la síntesis de las hebras complementarias se acaba el primer ciclo (que puede repetirse cuantas veces sea necesario). Por lo tanto, la cantidad de ADN que podemos obtener sólo está limitada, en teoría, por el número de veces que se repitan estos pasos. Analicémoslos con un poco más de detalle:

En primer lugar, se toma un fragmento de ADN y se calienta a unos 95ºC hasta que se disocia en dos cadenas sencillas (este proceso se denomina desnaturalización y dura normalmente 5 minutos).

Por métodos químicos se han sintetizado e incluido en la “mezcla primaria” dos cebadores 3 —tramos cortos de ADN de una sola cadena, por lo general de una longitud de alrededor de veinte pares de bases—, cuyas secuencias encajan en las regiones que flanquean el fragmento de ADN que nos interesa (por eso es indispensable conocer los dos extremos de la región del ADN que se quiere amplificar para que los cebadores hibriden con cada extremo, es decir, se combinen entre sí las dos cadenas de ácidos nucleicos). De esta forma, los cebadores delimitan nuestro tramo de ADN o gen diana. Se necesitan dos cebadores diferentes, uno para cada una de las cadenas disociadas: uno es idéntico al extremo terminal 5’ de la hebra codificante y el otro idéntico al extremo 3’ de la hebra no codificante. Este paso, conocido como alineamiento o hibridación, es el de menor temperatura de la PCR y el que marca la especificidad de la reacción.

Por último, en el último paso, de extensión, interviene la ADN polimerasa, la enzima que facilita el proceso de replicación del ADN mediante el emparejamiento de los desoxirribonucleótidos trifosfato (dNTP) libres con los desoxirribonucleótidos complementarios del ADN molde. Aquí la temperatura sube a 72ºC porque esa es la temperatura en la cual la polimerasa alcanza su máxima actividad. Debemos tener presente que esta replicación sólo comienza donde el ADN ya es de doble cadena, es decir, en el lugar donde el cebador se ha hibridado en el paso anterior. La polimerasa hace una copia complementaria de la plantilla de ADN a partir de cada cebador, y por lo tanto, copia la región diana. Las ADN polimerasas pueden añadir hasta 1000 nucleótidos por segundo, y el producto final es una molécula de ADN de doble cadena.

Cada grupo de tres pasos (desnaturalización, alineamiento y extensión) se denomina ciclo; y la sucesión de una serie de ciclos en los que tiene lugar la desnaturalización del molde, la hibridación con los cebadores y la extensión de la síntesis por acción de la ADN polimerasa produce un aumento de forma geométrica del ADN resultante. Es decir, partiendo de cantidades mínimas (del orden de femtogramos), tras 30 ciclos se pueden obtener cantidades enormes (microgramos). Esto es así porque los productos de un ciclo se emplean como moldes del ciclo siguiente.

Hoy en día todos estos pasos se llevan a cabo en una máquina llamada termociclador, que calienta o enfría los tubos que contienen todos los “ingredientes” de forma precisa.

¿Qué pinta un microbiólogo en todo esto?

Nuestro segundo protagonista, y parte esencial en esta historia, es el microbiólogo Thomas Dale Brock, conocido por sus trabajos pioneros con bacterias extremófilas, los microorganismos que son capaces de prosperar en condiciones extremas (ya sean de temperatura, acidez, radiación o anoxia). Ha publicado más de 250 artículos y 20 libros, además de haber obtenido numerosos premios científicos 4.

Cuando comenzó a utilizarse la PCR surgió un problema importante con la ADN polimerasa, la enzima que hace el trabajo de copia. El método original empleaba la polimerasa de la bacteria Escherichia coli, pero su temperatura óptima de funcionamiento (37ºC) queda muy por debajo de los 95ºC necesarios para la desnaturalización del ADN, con lo que se destruía en el proceso. Por ese motivo era necesario añadir más enzima a la reacción tras cada ciclo. Si tenemos presente que la polimerasa es cara, comprenderemos que se viera que la PCR, a pesar de su enorme potencial, no era una herramienta económicamente práctica.

Entonces la madre naturaleza, la serendipia y nuestro microbiólogo vinieron al rescate.

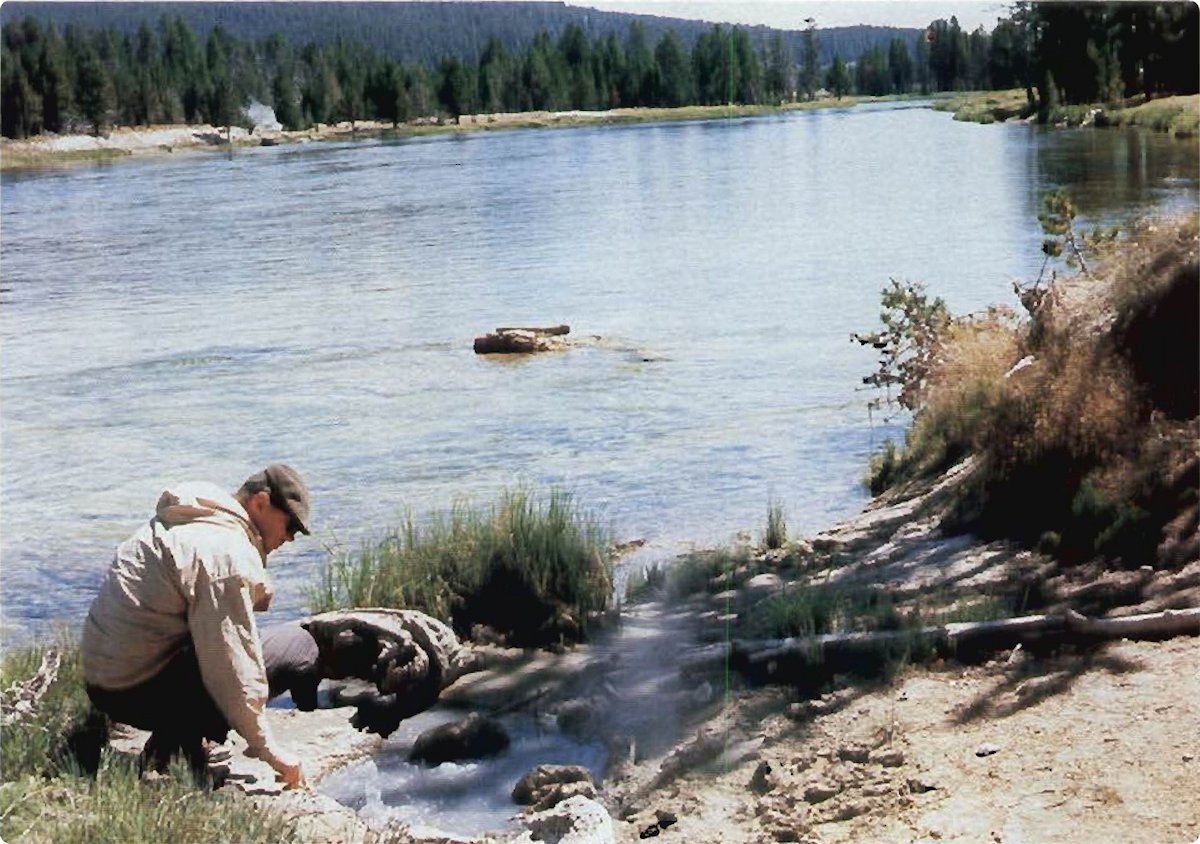

Debemos situarnos a comienzos del verano de 1964 y, de nuevo, con un largo trayecto por carretera como telón de fondo. Brock tenía que viajar desde Indiana (donde residía) a los laboratorios Friday Harbor de la Universidad de Washington en Seattle, donde tenía previsto pasar unas semanas llevando a cabo estudios de microbiología marina. Este trayecto, de unos 3.700 kilómetros por carretera, atraviesa Montana, Idaho y Wyoming, estados por donde se extiende el famosísimo Parque Nacional Yellowstone. Al igual que otros muchos norteamericanos, Brock había oído hablar maravillas de este prodigio de la naturaleza pero nunca había tenido ocasión de visitarlo así que esta vez no dejó pasar la oportunidad: el día que tomó ese desvío cambió el rumbo de la biología molecular.

Su primera parada fue en la West Thumb Geyser Basin, una de las cuencas de géiseres más pequeñas de Yellowstone aunque una de las más pintorescas. Allí experimentó un súbito impacto al ver las alfombras de algas de fuertes colores naranja, rojo y verde que tapizaban los manantiales que había por doquier.

A pesar de ser plenamente consciente de que las algas vivían en ambientes termales no estaba preparado para lo que vio. Continuó su viaje a la costa oeste donde pasó el verano en los laboratorios Friday Harbor, aunque no se pudo quitar Yellowstone de la cabeza. En el viaje de regreso a Indiana recaló allí de nuevo, esta vez con un poco más de tiempo, y tomó varias muestras.

En el verano siguiente decidió pasar allí dos semanas intensivas de investigación junto a su mujer antes de un viaje que tenía previsto realizar a Islandia. En Mushroom Spring fue donde se fijó por primera vez en unas masas de bacterias filamentosas rosadas, a partir de cuyas muestras (y gracias a la ayuda de Hudson Freeze) lograron aislar un organismo al que llamaron Thermus aquaticus 5.

Lo cierto es que dos años antes de la publicación de este descubrimiento, Brock ya había llamado la atención de la comunidad científica acerca de la importancia de investigar a fondo las fuentes termales del Parque Nacional Yellowstone. Lo hizo en un artículo que apareció como artículo principal de la revista Science 6, tras cuya publicación un buen número de bioquímicos de diferentes Universidades y de la industria se interesaron por estos microorganismos. Nuestro microbiólogo señaló entonces que una buena vía de investigación sería centrarse en las enzimas que actúan sobre el ADN, como las polimerasas. Su trabajo, sin embargo, continuó por otros derroteros.

Cuando muchos años más tarde se descubrió la reacción en cadena de la polimerasa, el valor de la enzima de Thermus aquaticus se puso de relieve.

La ADN polimerasa de este organismo (Polimerasa Taq) se caracterizó en 1976 en la Universidad de Cincinnati por Alice Chien, David Edgar, y John Trela; pero no fue hasta 1987 cuando se produjo el hito final: en diciembre de ese año se aceptó para la publicación en Science el artículo escrito por Kary Mullis y otros colegas 7 donde se explicaba la trascendencia de utilizar la ADN polimerasa de Thermus aquaticus para la reacción en cadena de la polimerasa 8.

El hecho clave es que esta enzima es activa y estable a altas temperaturas, lo que significa que no pierde su función tras el primer paso de la desnaturalización del ADN, y sólo tiene que añadirse al comienzo de la reacción: su temperatura óptima de funcionamiento se sitúa entre los 70ºC y 80ºC, momento en que la bacteria sintetiza ADN a la velocidad de 35–100 nucleótidos por segundo.

El primer termociclador para la PCR salió al mercado en 1987 y supuso la automatización de todo el proceso. La revista Science eligió la PCR como el desarrollo científico más importante de 1989, y otorgó a la Taq el premio a la molécula del año.

Conclusión

Esta historia nos sirve para traer a colación la importancia de la investigación básica —que la mayoría de las veces se lleva a cabo por científicos individuales o pequeños grupos de científicos en las universidades—. En estos casos es muy difícil predecir cuándo, dónde y a quién beneficiarán los eventuales rendimientos de las diferentes líneas de investigación pero, como hemos visto, incluso un trabajo que puede parecer tedioso o demasiado teórico puede tener un impacto decisivo en el avance de la ciencia.

Artículos principales

Brock, T. D. y Freeze, H. (1969), «Thermus aquaticus gen. n. and sp. n., a nonsporulating extreme thermophile«. Journal of Bacteriology, vol. 98, núm. 1, p. 289-297.

Mullis, K., et al. (1986), «Specific enzymatic amplification of DNA in vitro: The polymerase chain reaction«. Cold Spring Harbor Symposia on Quantitative Biology, vol. 51, p. 263-273.

Saiki, R. K., et al. (1985), «Enzymatic amplification of beta-globin genomic sequences and restriction site analysis for diagnosis of sickle cell anemia». Science, vol. 230, núm. 4732, p. 1350-1354.

Saiki, R. K., et al. (1988), «Primer-directed enzymatic amplification of DNA with a thermostable DNA polymerase«. Science, vol. 239, núm. 4839, p. 487-491.

Más información

Brock, T. D. (1967), «Life at high temperatures». Science, vol. 158, núm. 3804, p. 1012-1019.

─── (1978), Thermophilic microorganisms and life at high temperatures. New York: Springer-Verlag, xi, 465 p.

Brock, T. D. (1997), «The value of basic research: discovery of Thermus aquaticus and other extreme thermophiles». Genetics, vol. 146, núm. 4, p. 1207-1210.

Celada, A. (1994), Inmunología básica. Barcelona: Labor, 654 p.

Eguiarte, L., et al. (2007), Ecología molecular. México D.F.: Instituto Nacional de Ecología, 594 p.

Elliott, W. H., et al. (2002), Bioquímica y biología molecular. Barcelona: Ariel, XXVII, 788 p.

Izquierdo Rojo, M. (1999), Ingeniería genética y transferencia genética. Madrid: Pirámide, 335 p.

Klug, W. S. y Cummings, M. R. (1999), Conceptos de genética. Madrid: Prentice Hall, 840 p.

Mullis, K. B. (1990), «The unusual origin of the polymerase chain reaction». Scientific American, vol. 262, núm. 4, p. 56-65.

Watson, J. D. y Berry, A. (2003), DNA: the secret of life. New York: Alfred A. Knopf, xiv, 446 p.

![]()

Notas

- Al menos es lo que ha explicado hasta la saciedad cada vez que le han dado una oportunidad para ello. La versión que se ofrece aquí proviene del artículo escrito por él mismo para Scientific American titulado The unusual origin of the polymerase chain reaction. ↩

- Algo que es bueno recordar a quienes rechazan de plano cualquier organismo genéticamente modificado. ↩

- También llamados primers. ↩

- Pero, sorprendentemente, no el Nobel. ↩

- Que fue descrito en un artículo publicado en el Journal of Bacteriology titulado Thermus aquaticus gen. n. and sp. n., a nonsporulating extreme thermophile. ↩

- Life at high temperatures. Este artículo se ha convertido en uno de los más citados en su campo. ↩

- El artículo vio la luz en enero de 1988 bajo el título Primer-directed enzymatic amplification of DNA with a thermostable DNA polymerase. ↩

- La idea de usar una bacteria termófila como fuente de la ADN polimerasa fue de David Gelfand, coautor de este artículo, aunque John Trela había realizado un trabajo similar en 1975, lo que derivó en una batalla legal entre ambos al discutirse la validez de la patente de la “Taq” presentada por Gelfand. ↩